文 | 黑爪

前几天读到公众号“今日话题”一篇题为《也许有一天,人类要向人工智能学习怎么做人》的文章,文中在引述了近期因“规则意识缺乏”而酿成的几起社会热点事件后,提及DeepMind(谷歌母公司阿尔法贝特“Alphabet”的人工智能分部)最近开展的一项关于智能体(Agent)之间合作倾向的实验。文章称DeepMind通过AI技术“找到了解决社会困境问题的新工具”,并且认为它所模拟出的“理性人”,“是真正的‘理性人’ ,而不是人类这种存在诸多缺点的”。不得不说,这有些误解,不仅夸大了这个实验本身的初衷,更一厢情愿地美化了它的结果。

顾名思义,AI是有智慧的,起码某个方向、某种程度的智慧。但它在利用智力开展工作时,是否依靠理性来进行抉择和决策就不一定了。这就必须首先回到人类本身——人工智能的学习对象——来看。合作与否,在人类活动中,属于理性而非智力的决策,因此理解它们之间的差异,对于帮助我们看懂这个谷歌实验的意义很有必要。

智力和理性的话题,去年《纽约时报》刊登过一篇探讨人类认知属性的文章,它开篇就问:“你是智慧的,还是理性的?”看上去很有点像网上流行的人格/性格测试 。文章回顾了最早于20世纪70年代初,以色列裔美国心理学家,2002年诺贝尔经济学奖得主丹尼尔·卡尼曼(Daniel Kahneman)与他的研究伙伴,认知科学先驱人物阿摩司·特沃斯基(Amos Tversky)合作展开的一系列实验。简单地说,他们经过大量不同情节设置的实验,认为人们在做决定时,往往倾向于直觉,而非理性推断。

举一个例,他们让人给一群研究对象读一段话,这段话描述了一位叫琳达的妇女:“琳达31岁,单身,直言而聪慧,曾主修哲学,求学期间,她极其关心有关歧视和社会公正等议题,并参加过反核游行。”然后他们让研究对象做选择,哪一项的可能性更大:A琳达是一位银行出纳,B琳达是一位银行出纳,并积极参与女权运动。85%的研究对象选择了B。但从逻辑的角度看,A的可能性绝对更大,因为,所有的女权主义出纳员,都是出纳员;而并非所有的出纳员都是女权主义者。

这是一个思维陷阱,一个被叫做“合取谬误”(conjunction fallacy)的坑,使得人们认为多重条件“甲且乙”比单一条件“甲”发生的可能性更大。简言之,这个实验结果让他们认为,人类从根本上来看,是非理性的。

然而到了1990年代后期,研究者们开始质疑这个观点。心理学家凯斯·斯坦诺维奇(Keith E. Stanovich)发现,就连卡尼曼和特沃斯基自己留下的数据也显示出,其实有相当一部分人,是有明显理性倾向的。

这么一来,是否理性就成了个体差异。有趣的是,与智力不同,理性能力是可以通过训练得到提升的,开始靠近我们的主题“机器学习”了。

说回谷歌DeepMind关于智能体合作倾向的实验。简单地说,它是利用多智能体(multi-agent)的深度学习来模拟出一个促使合作出现的模型。其结果,更多地在于,希望它可以帮助我们更好地理解,从而更有效地控制复杂的多智能体系统的行为,例如经济、交通和环境等问题,而绝非找到了解决社会困境的钥匙。更重要的,实验结果恰恰揭示了理性智能体,也就是“今日话题”文中所说的“理性人”,一点也不比人类更守规矩,它们具有人类的一切弱点,面对不同环境所做出的反应,也与人类完全一致。

先解决几个拗口的词。什么是多智能体(multi-agent)?甚至,什么是智能体(agent)?“agent”,英文字面意思是代理,但放在计算机或者人工智能的语境里,“代理”显得语焉不详。这个概念是人工智能先驱,MIT的科学怪才马尔文·明斯基在他1985年的著作《意识的社会》(Society of Mind)里首次提出。事实上,它就是一个实体或者说主体,既可以是硬件,也可以是软件。因为具有自治性,对外界刺激做出相应反应的能力,社会性以及自动学习修正从而进化等特性,而被称作“智能体”。那么多智能体,顾名思义,就是多个智能体的集合,成员间可以通信和协调,以达成多智能体的目标。如果将鸟群或者兽群想象成多智能体,也许就容易理解一些。

这里显然留下了一个问题,多智能体成员间,或者说鸟群和兽群的成员间,刚才说到会彼此协调,这个协调,是合作还是竞争,还是彼此进攻?

这正是DeepMind希望通过这个实验模型来发现的答案。而结果显示,AI也会逞强斗勇,会贪婪,会产生不安全感。不过好消息是,经过反复的学习,它们会发现合作是共赢的出路。

在不完美的天性,吃一堑长一智这样的过程面前,人类和AI是平等的,谁都没有躲过。

天性自私的人类,从诞生起,就一直通过协同工作,直至创造出了今日的文明。如果把每个人比做一个自私的智能体,整个社会是一个多智能体。在什么情形下,如何让这些自私的智能体合作,是社会学领域的一个基本问题。

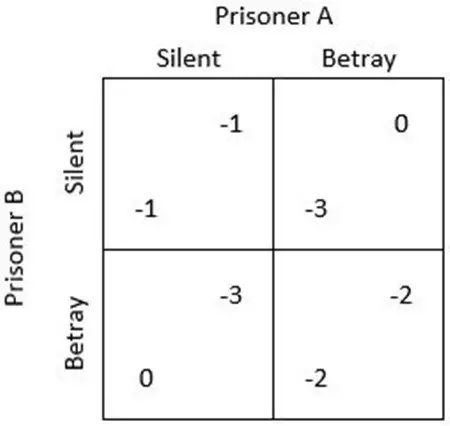

用来描述这个现象的,有一个最简单经典的模型,就是博弈论中著名的囚徒困境(Prisoner's Dilemma):两个犯罪嫌疑人被单独关押,在没有得到他们招供的情况下,警方没有足够证据对他们的主要指控定罪,但足够用次要指控处以他们每人一年的监禁。为了引诱这二名囚徒招供,他们分别向他俩提出如下条件:如果你作证指控对方(也就是如果你叛变),你将获释,而对方将服刑三年;如果两人都招供,则两人均服刑两年;若二人默契协作,都保持沉默,不指控对方,则两人都只服刑一年。

这两个理性智能体(囚徒)总是选择招供,也就是背叛伙伴,因为无论对方选择如何,一定是招供对自己最有利。矛盾的是,如果两个囚徒都同样以这个思路来决策的话,两人均会服刑两年,这比起二人协作,保持沉默的情况多出了一年。这个囚徒困境的矛盾可以推而广之,用来描述通用的社会困境。

▲ 囚徒博弈

由于人工智能尤其是深度强化学习方面的最新进展,使我们得以重新来看待这个问题。传统的模型只为每个智能体提供简单的二元选择:合作或背叛;而现实生活中,无论合作还是背叛,哪种选择其实都要求了一系列的复杂行为,包含了一系列具有难度的行动,需要智能体去学习执行。因此经由深度强化学习训练后的人工智能,便被利用来重新研究这一困境。

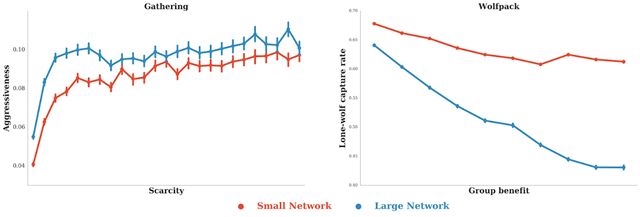

DeepMind实施的第一个游戏叫捡苹果(Gathering):一红一蓝两个智能体,在一个共同的空间里活动,目的都是捡苹果,换奖赏。他们也可以通过向对方发射激光柱来“定死”对方,使其在一定时间内出局;“定死”对方这个行动本身不获得奖励。

游戏在整个实验中重复了几千次,通过这种反复博弈来“学习”理智的行为。很自然地,当整个环境能够提供充足的苹果时,智能体们和平共处,努力捡苹果;然而一旦苹果数目下降,智能体们学到的便是“激烈进取原则”,开始向彼此发射激光柱,把对方“定死”,以便自己独占珍稀资源,获取更高的得奖机会。

从设置“定死”这个可选的行为,到调整苹果数目以使其稀有,设计者(DeepMind团队)都无异于有意在“挑起群众斗群众”,其目的是观察智能体在不同情形下的行为变化。他们发现,这个捡苹果游戏与最初的囚徒困境有很多相似之处:合作,一起捡苹果;还是背叛,将对方踢出局。

是哪些因素导致了智能体的合作?

比如捡苹果游戏中,苹果稀少的状况越严重,“定死”对方的行为就发生得越频繁。智能体甚至渐渐有能力实现更为复杂的策略,例如怎样更加频繁地“定死”对方,换言之,表现得越来越趋于不合作,而且不合作的能力也在反复博弈的学习过程中越来越强,无论实验人员怎样干预,调整苹果的稀少程度。

AI与人类在这个问题上没有不同,它们的行为模式在社交困境中发生改变,它们不是人们呼唤的“遵守规则”的社会标兵。“贪婪动机反映出来,便是它们会想要除掉他人,让自己独占所有的苹果;而感觉到有可能被竞争者除掉的危险,反映出来便是恐惧。”DeepMind的研究人员在观察日记中写道。

有意思的是,DeepMind实施的第二个叫“狼群”(Wolfpack)的游戏,它本身要求必须紧密合作才能成功。两个红色的智能体,也就是游戏中的“狼”,追捕一个蓝色的智能体,也就是游戏中的“猎物”。如果猎物被抓住时,两只狼都在附近,它们将同时获得奖励;而如果某一只狼想办法独自捕获了猎物,却存在猎物尸体被第三方食腐动物叼走的危险。于是智能体们通过学习,它们之间的合作变得越来越紧密,通力将“蓝点”逼进逃无可逃的角落,从而将它们一个个捕获。

结果显示,智能体执行更复杂策略的能力越高,换言之越聪明,它们之间的合作度越高,这与在捡苹果游戏中的发现恰恰相反。

▲ 捡苹果游戏和狼群游戏

(捡苹果游戏和狼群游戏的说明:左右二图中,红线均表示小网络实验结果,蓝线均表示大网络实验结果。左图为捡苹果游戏,横轴为苹果稀缺度,纵轴为智能体的竞争性;右图为狼群游戏,横轴为集体利益,纵轴为“独狼”,即不合作捕获猎物的比例)

因此,根据情形不同,一旦智能体拥有了执行更复杂策略的更强能力,可能导致两种不同的结果:更合作或者更不合作。

前文的心理学实验已经告诉我们,训练智能体间的合作是可能的。而这两个游戏的结果则说明,让他们合作的前提,是提供尽可能正确的规则,以及合理的激励(比如狼群游戏会奖励合作,而捡苹果则不会)。一旦逞强斗勇的行为能给自己带来好处(例如在苹果稀缺时用激光柱“定死”对方),毫无疑问,AI就会变得好斗而缺乏合作精神。同人类一样,AI会根据环境来改变自己的行为,当感受到足够的威胁,而使自己可能失掉机会的时候,就会变得逞强斗勇;而一旦发现合作能带给自己更大的利益,它们将会毫不犹疑地去合作。

“合作的促成”,这一社会领域神秘而“古老”的话题,显然通过现代AI技术发现了一丝曙光,借此我们能够更好地去理解经济、交通、以及我们所生存的星球的生态健康。所有这一切,都有赖于我们,人类这个多智能体的每一个成员间持续的合作。脸书创始人马克·扎克伯格在2017年2月16日下午以“建立地球村”为题发出一封致全体村民的公开信,也许真如这份被媒体称作扎克伯格宣言中所说,到了用算法拯救世界的时候?